A Meta destilou sua tecnologia Avatars de codec de corpo inteiro para renderizar 3 de uma só vez no Quest 3 Standalone, com algumas trocas notáveis.

Há cerca de uma década, a Meta está pesquisando e desenvolvendo a tecnologia que chama de avatares de codec, representações digitais fotorrealistas de seres humanos conduzidos em tempo real pelo rastreamento de face e olhos dos fones de ouvido VR. O protótipo da mais alta qualidade alcança o feito notável de atravessar o vale estranho, em nossa experiência.

O objetivo dos avatares do codec é oferecer presença social, o sentimento subconsciente de que você está realmente com outra pessoa, apesar de não estar fisicamente lá. Nenhuma tecnologia de tela plana pode fazer isso. Chamadas de vídeo nem chegam perto.

Para eventualmente enviar avatares de codec, a Meta tem trabalhado para aumentar o realismo e a adaptabilidade do sistema, reduzindo os requisitos de renderização em tempo real e possibilitando gerá-los com um Digitalização para smartphone.

Por exemplo, na semana passada, relatamos no Meta’s Último progresso Em avatares de codec altamente realistas da cabeça que podem ser gerados a partir de um vídeo de selfie de você girando sua cabeça, além de cerca de uma hora de processamento em uma GPU do servidor. Isso se tornou possível graças à divisão gaussiana, o que nos últimos anos fez para renderização volumétrica realista que os grandes modelos de idiomas (LLMS) fizeram para os chatbots.

Os ‘avatares de codec’ fotorrealistas de Meta agora têm penteados mutáveis

O prototipo de meta ‘Avatares de codec fotorealista agora suporta penteados mutáveis, modelando separadamente a cabeça e o cabelo.

Mas esse sistema ainda foi projetado para ser executado em uma poderosa placa gráfica de PC. Agora, os pesquisadores de meta descobriram como obter seus corpo inteiro Avatares de codec em tempo real na Quest 3.

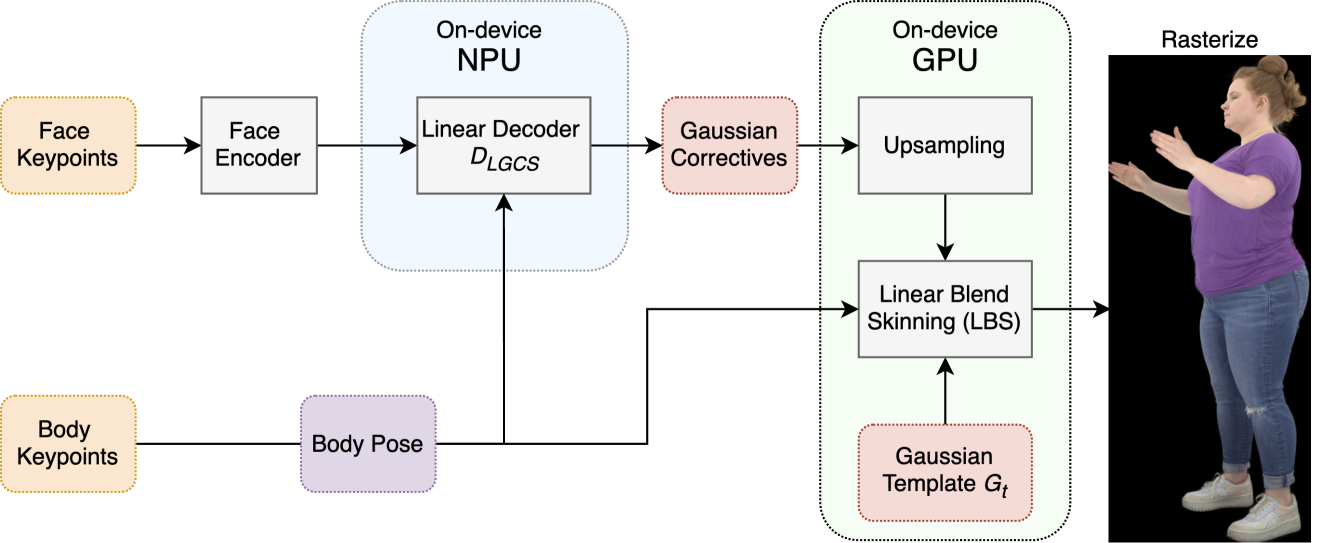

Em um papel Chamado “Squeezeme: destilação pronta para celular de avatares de corpo inteiro gaussiano”, os pesquisadores descrevem como destilam seus avatares fotorrealistas de corpo inteiro para correr em um chipset móvel, alavancando a NPU e a GPU.

Você deve ter ouvido o termo destilação no contexto do LLMS, ou IA em geral. Refere -se ao uso da saída de um modelo grande e computacionalmente caro para treinar um modelo muito menor. A idéia é que o modelo pequeno possa replicar o modelo maior com eficiência, com perda mínima de qualidade.

Os pesquisadores dizem que Squeezeme pode render 3 avatares de corpo inteiro a 72 qps em uma missão 3, com quase nenhuma perda de qualidade em comparação com as versões renderizadas em um PC.

No entanto, existem algumas trocas importantes para observar.

Esses avatares são gerados usando a enorme matriz de captura personalizada tradicional de mais de 100 câmeras e centenas de luzes, não a nova abordagem de smartphone de ‘modelo universal’ da outra pesquisa recente de Avatares de Codec da Meta.

Eles também têm iluminação plana e não suportam a release dinâmica. Esse suporte é um recurso principal dos mais recentes avatares de codec baseado em PC da Meta e seria crucial para fazê-los se encaixar em ambientes de RV e realidade mista.

Ainda assim, esta pesquisa é um passo promissor em direção à Meta, eventualmente, enviando avatares de codec como uma característica real de seus fones de ouvido do Horizon OS.

A pressão pública para a meta enviar o que está pesquisando há uma década se acumulou significativamente este ano, pois a Apple está enviando seu novas personas em Visionos 26efetivamente cumprir a promessa da Meta.

No entanto, nem o Quest 3 nem o Quest 3s têm rastreamento ocular ou rastreamento de rosto, e não há indicação de que os meta -planos de lançar iminentemente outro fone de ouvido com essas capacidades. Quest Pro tinha os dois, mas foi descontinuado No início deste ano.

Meta Connect 2025 acontece 17 e 18 de setembro

A Meta Connect 2025 ocorrerá nos dias 17 e 18 de setembro, prometendo “descascar a cortina da tecnologia de amanhã”. Aqui está o que esperamos ser anunciado.

Uma possibilidade é que a Meta inicie uma versão rudimentar de tela plana dos avatares de codec com rastreamento de rosto simulado da IA primeiro, para permitir que você participe do WhatsApp e do Messenger Video Chamadas com uma forma mais realista do que Seu meta avatar.

Meta Connect 2025 acontecerá de 17 de setembroe a empresa pode compartilhar mais sobre seu progresso nos avatares do codec então.